Sintesi del progetto

Il progetto nasce dalla necessità di integrare in modo efficace i processi di development and IT operations (DevOps) con le attività di Machine Learning svolte su infrastrutture HPC. In molti contesti enterprise, infatti, i flussi di lavoro di intelligenza artificiale devono essere eseguiti in ambienti differenti – cloud, HPC e infrastrutture private – rispettando requisiti stringenti di sicurezza e privacy.

Obiettivi

La finalità principale del progetto è migliorare gli strumenti DevOps aziendali affinché possano governare l’esecuzione di applicazioni di Machine Learning su sistemi HPC. Il progetto punta a definire un’architettura di riferimento che descriva connessioni, componenti e procedure necessarie per far dialogare i diversi ambienti di calcolo e garantire flussi riproducibili, scalabili e sicuri.

Problemi e necessità

L’integrazione tra pipeline ML e infrastrutture eterogenee è complessa. Le esigenze di performance rendono indispensabile l’uso dell’HPC, mentre i vincoli normativi impongono che i dati sensibili restino confinati nell’ambiente corretto. Occorre quindi un sistema capace di coordinare il workflow senza spostare informazioni critiche e mantenendo coerenza tra i diversi cluster.

Soluzioni sviluppate

Il progetto ha realizzato un’architettura ibrida che consente di eseguire un workflow ML completo attraverso cloud, HPC e ambienti privati. Il workflow, descritto tramite Common Workflow Language (CWL), è stato validato e orchestrato con StreamFlow, che gestisce l’esecuzione distribuita in modo affidabile. È stata configurata la connettività tra i cluster, assicurando trasferimenti di dati sicuri ed efficienti. Sono stati inoltre integrati meccanismi di parallelizzazione che permettono l’addestramento simultaneo di più modelli, accelerando sperimentazione e ottimizzazione. Un ulteriore risultato riguarda il rispetto della privacy. Il workflow mantiene infatti dati sensibili e codice negli ambienti previsti, senza comprometterne la protezione.

Impatti

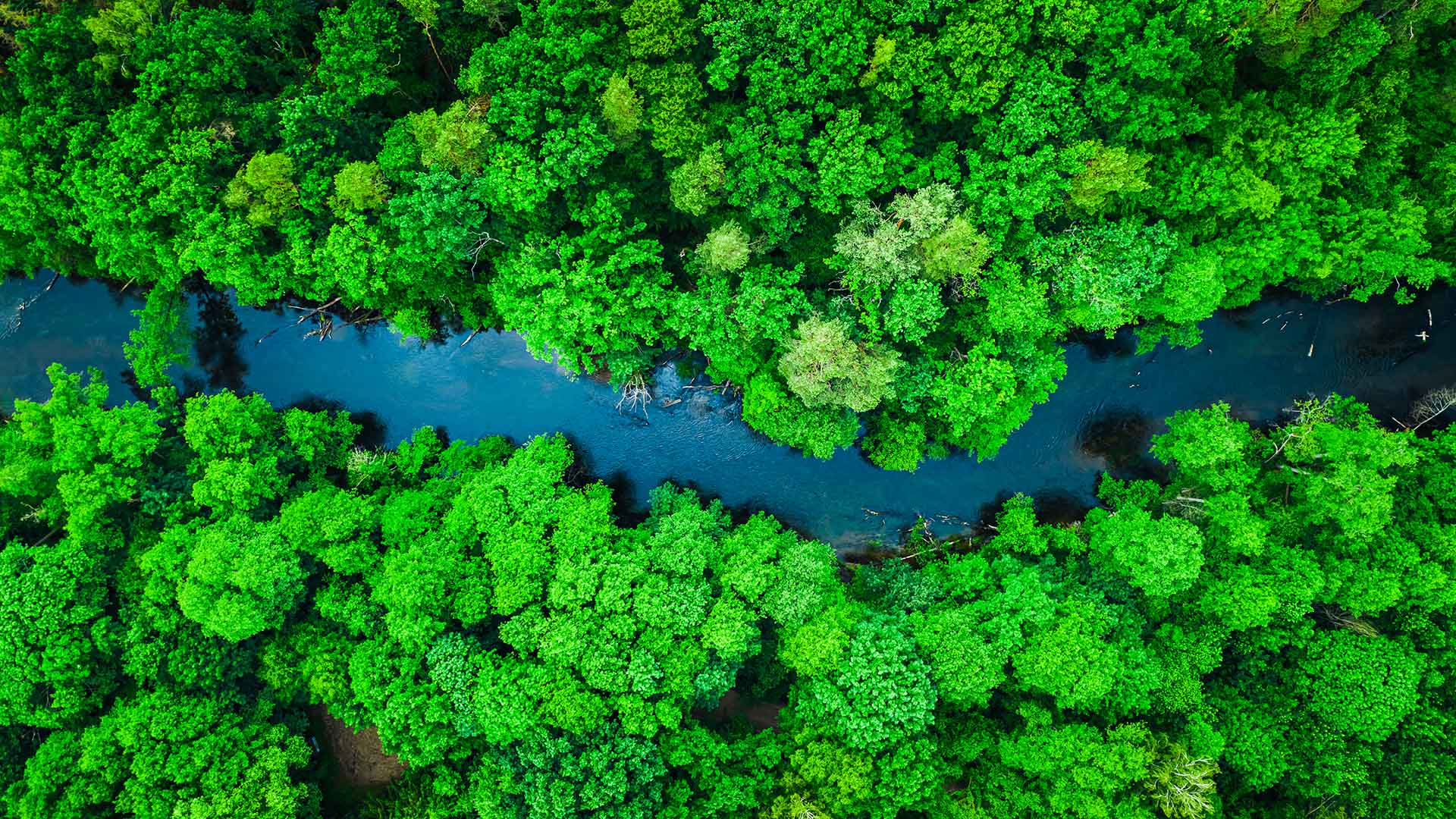

L’architettura ottenuta permette di potenziare l’efficienza dei sistemi di AI utilizzati da enti pubblici e aziende. La possibilità di combinare calcolo ad alte prestazioni e tutela dei dati consente analisi più rapide e affidabili, migliorando servizi come monitoraggio territoriale, valutazioni ambientali o gestione di dataset complessi. In prospettiva, queste tecnologie possono contribuire allo sviluppo di città più intelligenti, infrastrutture meglio pianificate e processi decisionali più informati.

Settori di applicazione

La soluzione sviluppata può essere applicata a molti domini, dai Servizi Pubblici alla Sanità, dalla Pubblica Amministrazione al Settore Industriale. Il workflow modulare rende semplice adattare l’architettura a modelli e dataset diversi. In prospettiva, saranno implementati test su larga scala, potenziamento dell’automazione, monitoraggio avanzato e creazione di materiali formativi che agevolino l’adozione da parte di altre organizzazioni.